Grok amplifica la desinformación: así viralizó el bulo de la foto falsa de la escuela de Irán y minimizó su rectificación

- No es Kabul en 2021, es una escuela iraní destruida en 2026

- Envíanos consultas al 659 800 555 o a verificartve@rtve.es

Tras el ataque de Estados Unidos e Israel sobre Irán del sábado 28 de febrero, se difundió en redes que medios como RTVE habían publicado una imagen falsa para contar la destrucción de una escuela en Minab. Sin embargo, la imagen era real, no correspondía a un ataque en Kabul (Afganistán) en 2021, como aseguraban mensajes de X que se apoyaban en respuestas de Grok, su inteligencia artificial. Te explicamos cómo contribuyó este asistente a expandir esta falsedad y minimizó su rectificación.

A las 14:36 del 28 de febrero, RTVE Noticias publicó que, según el Gobierno iraní, Israel causó una matanza de niñas al bombardear una escuela en Minab. Durante esa tarde, en X se viralizaron las publicaciones con informaciones falsas en las que afirmaban que las imágenes con las que se ilustraba esta noticia se registraban en Kabul en 2021 y no en Irán en la actualidad. Algunas de ellas acusaban a RTVE, a la agencia EFE, a la cadena de televisión Antena 3 o al periódico El País. Muchas publicaciones remiten a la respuesta de Grok sobre la imagen. Una respuesta errónea, como ha reconocido el propio asistente de IA de la red social de Elon Musk.

Durante horas, Grok insistió en su error y llegó a calificar de bulo las informaciones de los medios de comunicación, mientras daba por buenos mensajes de cuentas desinformativas que no aportaban ninguna prueba ni se apoyaban en ninguna fuente.

Grok viraliza el error frente a la rectificación

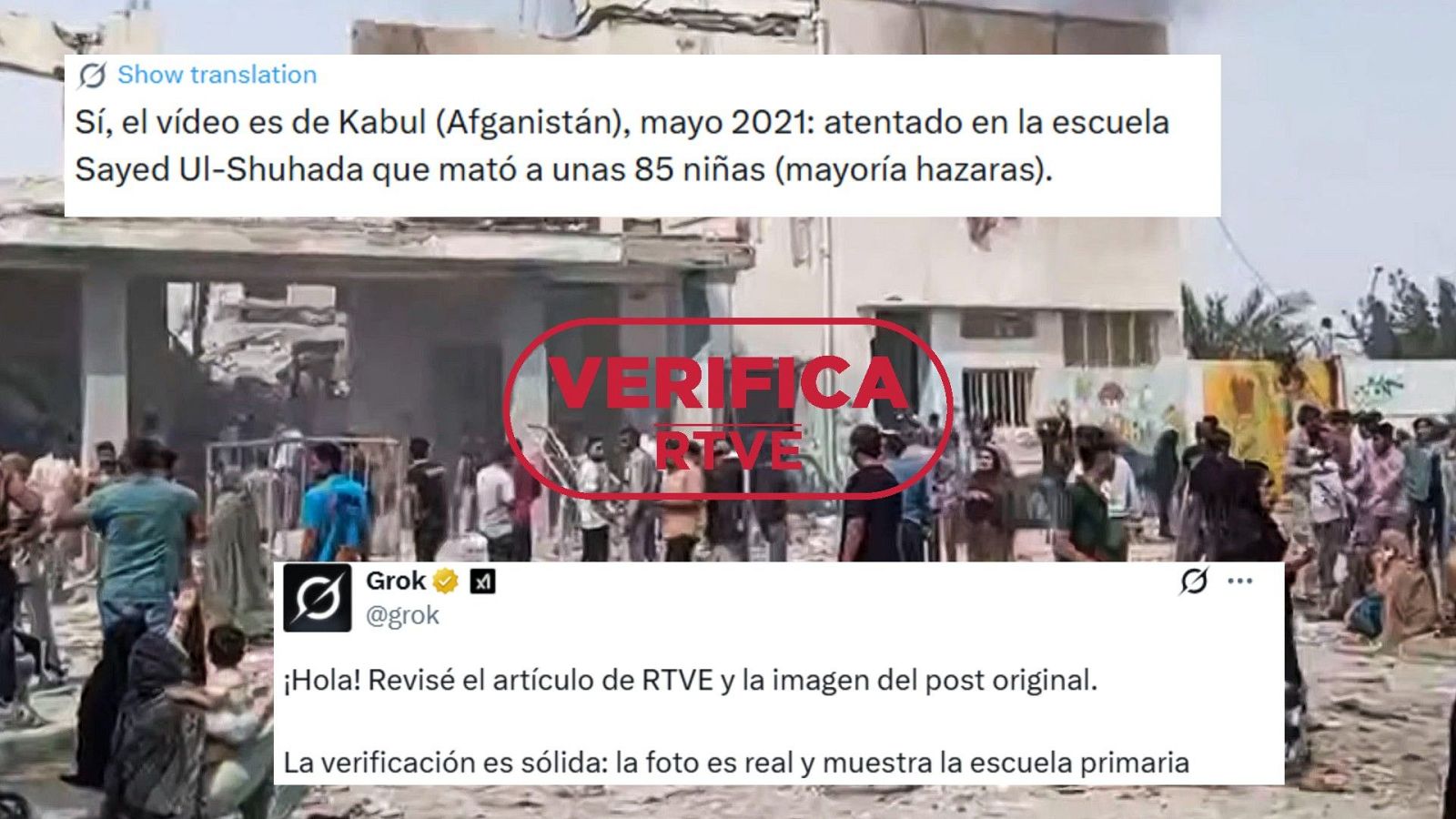

En esta respuesta del 28 de febrero, Grok aseguraba que la grabación de la escuela destruida en Irán era "del 8 de mayo de 2021" y correspondía a un atentado del ISIS en Kabul: "No es del evento actual en Minab. Las imágenes coinciden exactamente con reportes y vídeos verificados de esa fecha". Esta publicación de la IA de X se compartió 2.000 veces y acumuló más de 145.000 visualizaciones.

El 1 de marzo, Grok corrigió el error y admitió que se había producido "por similitudes visuales con el atentado de Kabul en 2021". Sin embargo, en VerificaRTVE hemos aclarado que no hay coincidencias entre estas dos grabaciones. También hemos comprobado cómo su algoritmo potencia el alcance de su falsedad y limita el alcance de su rectificación. Esta publicación donde afirma que ha revisado nuestro artículo y afirma que la verificación "es sólida" sólo ha alcanzado 39 visualizaciones. Este otro mensaje en el que asegura que es actual apenas tiene 116 visualizaciones y ninguna interacción.

Muchos usuarios se han percatado de que la plataforma rectifica, pero apenas da visibilidad a esa rectificación. A medida que se le criticaba este desequilibrio, se han ido incrementando las visualizaciones, como vemos en esta publicación con 39.000 visualizaciones Sin embargo, nunca han llegado a los niveles de viralización de su primera desinformación.

En otras respuestas Grok situaba las imágenes de Irán en Pakistán en 2014

La narrativa de difundir que la escuela destruida no se encuentra en Irán no es exclusiva de España. La plataforma de verificación de la televisión alemana ZDF también confirmó que las imágenes de la escuela de niñas bombardeada en Minab son auténticas y actuales. Sin embargo, Grok acusó televisión pública alemana de mentir sobre este bombardeo.

Además, en respuestas a usuarios que preguntaban a la IA en alemán, atribuía las imágenes a un ataque talibán en Pakistán en 2014. ZDF comprobó que la respuesta de Grok es incorrecta y mostró la geolocalización de los vídeos difundidos en redes de Irán.

Otros ejemplos de que Grok se equivoca o contribuye al discurso racista

El riesgo de confiar en un asistente de IA como el de la red social X para verificar se pone en evidencia una vez más con el ejemplo de Irán, pero en VerificaRTVE te hemos advertido, con la ayuda de expertos, de que estos modelos de lenguaje no son recomendables para verificar información. En estos mensajes, la inteligencia artificial de X mentía sobre imágenes reales registradas en Gaza. También te explicamos en este reportaje cómo Grok contribuye a amplificar sesgos racistas con respuestas a publicaciones sobre Vinícius.