La nueva cara del odio: cómo la inteligencia artificial alimenta la transfobia

- Diccionario de falsedades y bulos contra las personas LGTBIQ+

- Envíanos consultas al 659 800 555 o a verificartve@rtve.es

De la ex primera ministra de Nueva Zelanda Jacinda Ardern, pasando por la primera dama de Francia, Brigitte Macron, a la boxeadora argelina Imane Khelif. Son muchas las personas, mayoritariamente mujeres que son figuras públicas, que han sido objetivo de imágenes alteradas y montajes fotográficos que cambian su género para presentarlas como hombres. Unos contenidos falsos editados con inteligencia artificial (IA) que tienen un trasfondo: extender el discurso de odio contra las personas transexuales. En VerificaRTVE explicamos con varios ejemplos esta narrativa desinformativa y analizamos con expertos cómo se realizan estas imágenes falsas y cómo amplifican la transfobia.

Estas imágenes falsas y manipuladas mediante IA circulan de manera recurrente en Internet y muestran a mujeres con rasgos masculinizados con el objetivo explícito de hacerlas pasar por hombres. Figuras públicas como la primera dama de Francia, Brigitte Macron, y la abogada y ex primera dama de los Estados Unidos Michelle Obama han sido víctimas de estos montajes fotográficos. También es el caso de las publicaciones que presentan como mujeres trans a la ex primera ministra de Nueva Zelanda Jacinda Ardern y a la esposa del presidente del Gobierno de España, Begoña Gómez. Sin embargo, estos montajes fotográficos trascienden el ámbito de la política: la boxeadora argelina Imane Khelif también han sido objeto de esta narrativa desinformativa. En todos los casos mencionados se ha utilizado una fotografía real de estas mujeres para modificarla digitalmente y difundir así la falsa idea de que en realidad son hombres. A continuación, mostraremos varios ejemplos.

Una narrativa desinformativa conocida como 'deepfake' ligero

En VerificaRTVE hemos analizado los ejemplos anteriormente mencionados con el profesor de la Universidad Politécnica de Cataluña y consejero delegado de Ugiat Technologies, Frances Tarrés. Nos explica que estas imágenes falsas se conocen como "deepfake ligero" porque "los cambios son muy simples desde el punto de vista tecnológico". Este experto asegura que estos contenidos falsos "pretenden dañar la reputación de personas públicas mediante el cambio de rasgos de género".

Sobre este punto, indica que "cuando comparamos la fotografía original con la que muestra el pretendido cambio de sexo, la manipulación solo afecta al género". Subraya que "no hay cambios en edad, ni pose, ni punto de vista". Cree que con estas fotos alteradas "se está buscando la simplicidad" y señala que en estos casos "se están usando aplicaciones de IA muy simplistas que permiten manipular las imágenes para conseguir efectos como añadir maquillaje o cambiar el género". En este sentido, Tarrés explica que este efecto se aprecia con claridad en las fotografías manipuladas de Jacinda Ardern y Brigitte Macron. Tarrés sostiene que las aplicaciones que se están empleando para manipular estas imágenes "son muy populares y están disponibles de forma gratuita o a muy bajo coste" y menciona algunas como "FaceApp, Reface, PicsArt, YouCam Makeup y FaceSwap". Según explica este experto, "la gran mayoría de estas herramientas, excepto FaceSwap, no realizan ningún cambio en cuanto a pose o perfil y mantienen las características básicas de la imagen original".

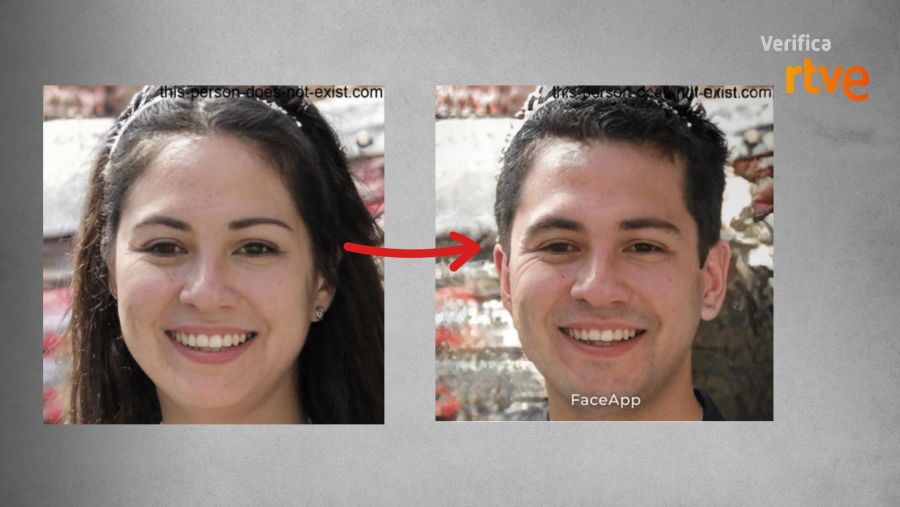

El profesor de la UPC nos ofrece un ejemplo práctico de cómo se realizan estas manipulaciones visuales "para modificar el género de una persona" con una herramienta como FaceApp. Nos explica que la imagen que se utiliza de base es la de una mujer generada sintéticamente con un algoritmo conocido como StyleGAN. A partir de esa instantánea, se ha aplicado el algoritmo de FaceApp y se realiza un cambio de sexo. El resultado obtenido se muestra en la siguiente imagen.

A la izquierda, imagen de base de una mujer y la derecha fotografía editada con FaceApp para cambiarle el género VerificaRTVE

La IA es una "nueva forma de violencia digital" más "sofisticada"

Para la Federación Estatal LGTBI+, la creación de estos montajes fotográficos "es una realidad preocupante". Su vicepresidente, David Armenteros, asegura a VerificaRTVE que "la inteligencia artificial se está utilizando como una herramienta más para extender los discursos de odio, y las personas trans están entre los colectivos más atacados". En esta línea, sostiene que "la proliferación de imágenes manipuladas, montajes ridiculizantes o contenidos visuales falsos buscan directamente atacar, cuestionar o negar la identidad de las personas trans". Por todo ello, Armenteros declara que se trata de "una nueva forma de violencia digital: más sofisticada, más rápida y más difícil de detectar". En su opinión, "una sola imagen puede construir una verdad, aunque sea falsa", y añade que "la IA permite crear estas imágenes con una apariencia de verdad que las hace aún más creíbles y, por tanto, más eficaces para el odio y generar discriminación".

Desde la Federación, inciden en que cuando ese contenido se hace viral "el daño se extiende a toda la comunidad trans". Su vicepresidente declara que "cada montaje, cada imagen que busca caricaturizar a las personas trans no solo hieren a una persona concreta, sino que refuerza los prejuicios que ya existen en la sociedad y legitima actitudes de rechazo".

Según el informe de 2024 de la organización ILGA Europe, el discurso de odio contra personas LGTBI en el entorno digital se ha disparado en España, con un incremento del 130% entre 2019 y 2022. Este aumento ha tenido como principal blanco a las personas trans. Por su parte, la Agencia de los Derechos Fundamentales de la Unión Europea (FRA) advierte de que tres de cada cuatro personas LGTBI+ en España han sido testigos, solo en el último año, de mensajes en redes que incitan a la violencia o ridiculizan al colectivo. A nivel nacional, los datos de la Oficina Nacional de Lucha contra los Delitos de Odio (Ministerio del Interior) señalan que la LGTBIfobia sigue siendo el segundo motivo más habitual en los delitos de odio registrados. Ante esta realidad que reflejan los datos, el vicepresidente de la Federación Estatal LGTBI+ incide en que "estamos hablando de violencia digital con consecuencias reales porque el odio virtual no se queda en la pantalla".

¿Cómo perseguir estos discursos tránsfobos?

Armenteros señala que lo primero es "reconocer que este tipo de contenido no es simplemente polémico o cuestionable". Sobre este punto, se muestra tajante: "Es violencia y discriminación hacia las personas trans y como tal, debe ser perseguido". Además, reflexiona sobre la necesidad de "actualizar de manera rápida y efectiva nuestra legislación para que contemple el uso de tecnologías como la IA en la generación de discursos de odio". Sobre este punto, asegura que en la actualidad muchas de estas herramientas "se están utilizando para atacar sin que existan mecanismos claros para denunciar ni para investigar".

Por otro lado, también incide en la importancia de que "los delitos de odio por identidad de género sean también abordados en el entorno digital". Para Armenteros, las víctimas deben contar con "canales eficaces para denunciar, ser protegidas desde el primer momento y ver cómo se responsabiliza a quienes crear y difunden este contenido". Por último, insiste en la "falta de sensibilización" puesto que "no todas las personas que comparten este tipo de contenidos lo hacen desde el odio, pero sí desde la organización". Por esta razón, concluye afirmando que hay que "educar para que la ciudadanía sepa identificar cuándo está frente a una imagen manipulada y qué consecuencias tiene compartirla".