El vídeo del ataque de EE.UU. a un barco con droga venezolano: ¿realidad o IA?

Estados Unidos afirma haber disparado este martes contra una embarcación cargada con droga de origen venezolano, en un ataque que se ha saldado con 11 muertos según la propia Casa Blanca. El presidente Donald Trump lo anunció a través de su red social, Truth Social, compartiendo una grabación de la explosión en el mar Caribe. Pero el Gobierno venezolano ha sembrado dudas sobre la autenticidad del vídeo: su ministro de Comunicaciones, Freddy Náñez, ha difundido que esas imágenes están generadas con inteligencia artificial, basándose en los resultados de una conversación con Gemini, el chatbot de Google. A fecha de publicación de este artículo, no hay pruebas que demuestren que este vídeo está generado con Inteligencia Artificial (IA).

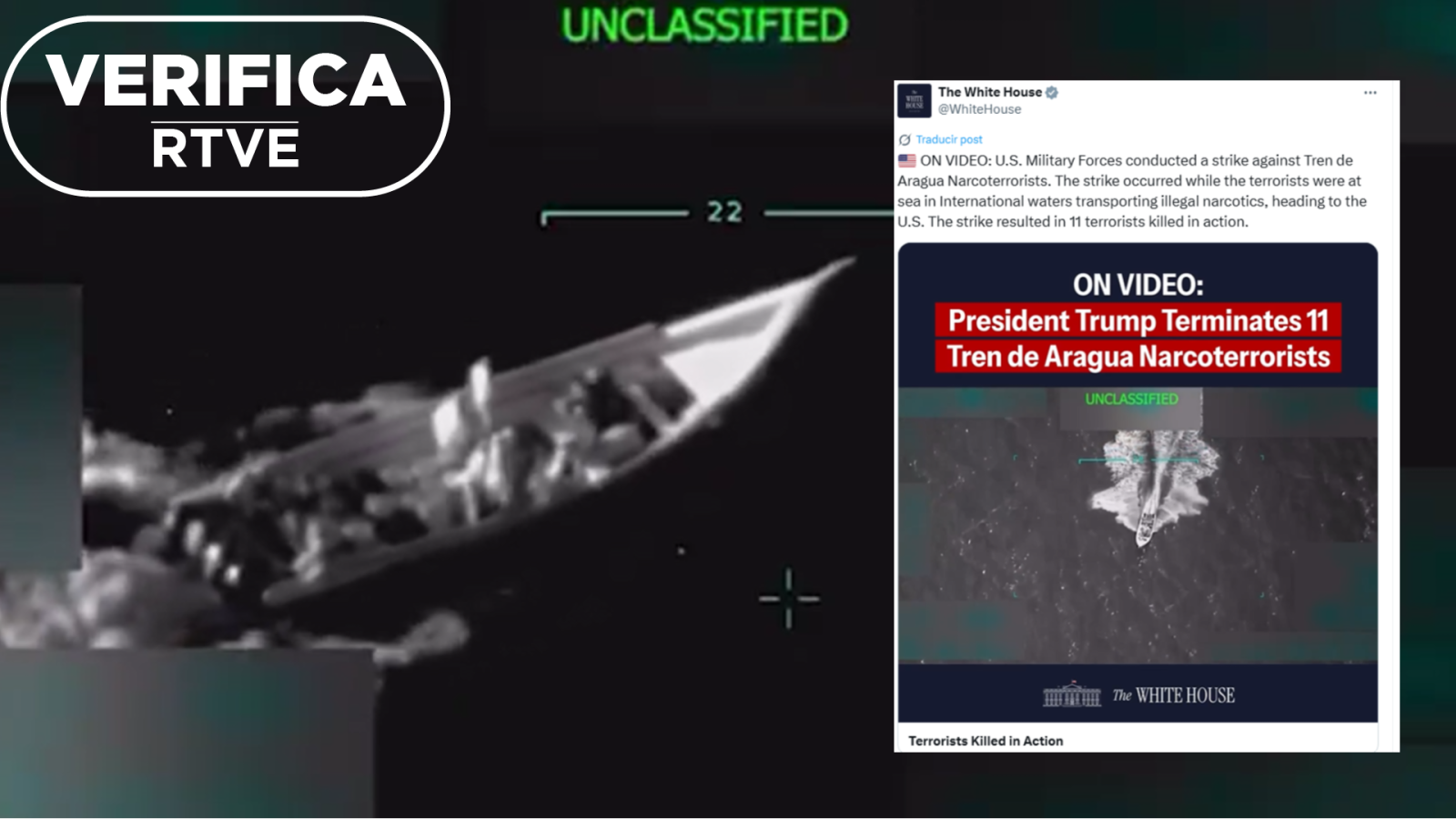

Trump difundió la grabación en Truth Social el martes 2 de septiembre. Dura 29 segundos y en ella se aprecia la visión nocturna de un barco que explota en el segundo 19. El vídeo está compuesto por cuatro secuencias diferentes. En la parte superior, hay un texto sobreimpresionado: "Unclassified" ("Sin clasificar", en inglés). En el mensaje difundido por Trump asegura que "las Fuerzas Militares de EE. UU. llevaron a cabo un ataque contra narcoterroristas del Tren de Aragua", en el que murieron "11 terroristas en combate" y "ningún miembro de las Fuerzas Armadas de Estados Unidos resultó herido".

Sin embargo, el Gobierno de Venezuela cuestiona la autenticidad de esta grabación compartida por el mandatario estadounidense. "Parece que Marco Rubio sigue mintiéndole a su presidente: luego de meterlo en un callejón sin salida, ahora le da como ‘prueba’ un video con IA", dijo el ministro Náñez en su publicación de X y de Telegram, apuntando hacia el secretario de Estado del Gobierno de Estados Unidos. A continuación, comparte la respuesta del chatbot de la IA de Google, Gemini: "Según el video proporcionado, es muy probable que se haya creado mediante inteligencia artificial (IA)". En su análisis, Gemini determina que la explosión del barco "parece una animación simplificada, casi de dibujos animados, en lugar de una representación realista", y añade que "contiene artefactos de movimiento y una falta de detalle realista, algo habitual en los vídeos generados por IA".

La prueba de VerificaRTVE ofrece el resultado opuesto

En VerificaRTVE hemos replicado los mismos pasos que el ministro Freddy Náñez, preguntando a Gemini sobre la veracidad del vídeo, pero los resultados que ofrece son radicalmente diferentes. "A pesar de la baja calidad y la falta de claridad, este vídeo no parece estar generado por inteligencia artificial", nos responde la propia IA de Google. También hemos hecho la misma comprobación con otras dos herramientas de conversación, ChatGPT y Perplexity AI. Ninguna de ellas detecta que las imágenes hayan sido creadas o manipuladas artificialmente.

También hemos analizado las instantáneas de la grabación a través de sistemas de detección de contenidos falsos: Decopy AI, Hive Moderation y SightEngine. Ninguna de ellas detecta que las imágenes estén generadas con inteligencia artificial. El análisis de Decopy AI muestra una probabilidad superior al 88% de que la imagen sea real y se basa en que "la estructura general de la embarcación y la posición de las personas se aprecian con cierta claridad, pero la resolución es baja y pixelada, lo que parece más coherente con la captura de una cámara de vigilancia o infrarroja que con imágenes generadas por IA".

Al tratarse de una grabación nocturna, en medio del mar, no hay elementos suficientes para determinar la ubicación exacta del ataque. Estados Unidos ha informado, a través del secretario de Estado, Marco Rubio, de que llevó "un ataque letal en el sur del Caribe contra una embarcación de drogas que había partido de Venezuela". En VerificaRTVE también hemos comprobado que el vídeo no se había compartido en redes sociales anteriormente.

Preguntar a la IA no es una prueba sólida para verificar la autenticidad de un vídeo

Los modelos de conversación de inteligencia artificial no funcionan como una herramienta útil para determinar la autenticidad de una grabación o de unas imágenes. Por ejemplo, sucede con la IA de X, Grok, que muchos usuarios utilizan como sistema de verificación, aunque los expertos como Nuria Oliver, del Instituto Tecnológico de Massachusetts (MIT), advierten de que "no hay garantía de veracidad", ni son "buscadores de información". Es por ello que "es absolutamente necesario confirmar prácticamente cualquier cosa que digan".

El verificador de la BBC Shayan Sardarizadeh, en respuesta al mensaje del ministro venezolano Freddy Náñez, ha indicado en su cuenta de X que no aprecia en el vídeo compartido por Trump ningún elemento "que sugiera que es falso o generado por IA". Al tiempo que puntualiza que "los chatbots de IA no son herramientas confiables para verificar hechos o determinar si un contenido es auténtico o no, y constantemente cometen errores".

Cabe señalar que, desde que regresó a la Casa Blanca, Donald Trump suele difundir otros contenidos que sí están generados con inteligencia artificial, y que, aunque a menudo son sencillos de detectar, los utiliza para extender su discurso. En julio publicó un vídeo del expresidente Barack Obama siendo arrestado por el FBI. Meses antes, difundió unas imágenes de IA con las que mostraba la Franja de Gaza reconstruida como un resort turístico, e incluso compartió una fotografía suya vestido de Papa. En este reportaje de VerificaRTVE analizamos cómo Trump utiliza la Inteligencia Artificial ante temas incómodos y plantea que "si ocurre algo realmente malo, solo hay que culpar a la IA".