Ucrania usa los móviles de sus ciudadanos para labores de inteligencia con el apoyo de una empresa de EE.UU.

- Envíanos consultas al 659 800 555 o a verificartve@rtve.es

- Suscríbete a nuestros desmentidos por RSS y practica con la Caja básica de herramientas

- Sigue el conflicto entre Rusia y Ucrania en directo

El Gobierno de Ucrania dispone de un sistema automático para interactuar con los móviles de ciudadanos que voluntariamente quieran ofrecer información relevante como fotos de tropas enemigas o de víctimas de la guerra (e-Enemigo). Según las autoridades ucranianas, hasta el momento ya lo han utilizado 275.000 personas. Este sistema cuenta con el apoyo de una empresa de EE.UU. que comercializa un programa de reconocimiento facial. Su uso como arma de propaganda o de incriminación es objeto de debate. La Inteligencia Artificial ha entrado en guerra antes de que los gobiernos hayan marcado sus límites.

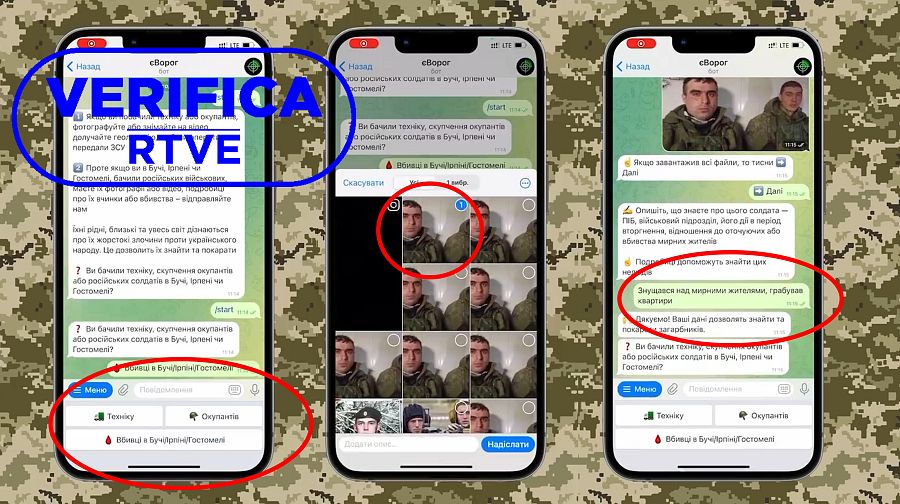

El sistema automático de colaboración ciudadana de Ucrania en la guerra con Rusia se llama “e-Enemigo” (en ucraniano єВорог). Se trata de un método basado en un bot (procedimiento de respuesta automática) de Telegram. El ciudadano de Ucrania que quiere unirse debe darse de alta en el sistema. Según el gobierno, este paso es necesario para evitar que los rusos se infiltren para ofrecer información falsa. El Ministerio de Transformación Digital ha publicado un vídeo tutorial que explica qué se debe hacer cuando se accede al bot. Primero pregunta si lo que se ha visto son vehículos, soldados o víctimas, luego el bot pide que se envíe una foto y la geolocalización del lugar de la foto. También pide al ciudadano que describa lo que ha visto.

Capturas del tutorial de 'e-Enemigo'. Primero se elige el tipo de denuncia, luego se adjunta la cara del soldado ruso y finalmente se describe lo que se ha visto y dónde se ubica. VerificaRTVE

‘e-Enemigo’ no es la única iniciativa de recopilación de evidencias digitales en previsión de un proceso posterior por posibles crímenes de guerra. En el perfil de Facebook de la organización pro ucraniana 5AM se ofrecen un conjunto de recursos alternativos para la preconstitución de pruebas como los que ofrece la Fiscalía General de Ucrania o la red cívica OPORA. La recopilación de pruebas digitales es la nueva protagonista de los procedimientos penales. El fiscal del Tribunal Penal Internacional, Karim A.A. Khan, afirmó en marzo de 2022: “Los conflictos y crisis internacionales generan ahora documentos audiovisuales en masa. La comisión de crímenes internacionales deja una huella digital significativa”.

Reconocimiento facial en tiempos de guerra

Las autoridades ucranianas animan a usar la aplicación “e-Enemigo” con frases como esta: “Si conseguiste fotos, vídeos, o grabaciones de cámaras de vigilancia con las caras de los monstruos rusos que cometieron genocidio en las ciudades de la región de Kiev, envíalos a la nueva sección de ‘e-Enemigo’”. Otro mensaje del Ministerio de Transformación Digital dice: “Gracias a la Inteligencia Artificial, el Ministerio continúa reconociendo las caras de los saqueadores, violadores y asesinos que destruyeron sin compasión las ciudades ocupadas de [la provincia de] Kiev. Cuanto antes les atrapemos gracias a las ‘pistas de sangre reciente’, antes les castigaremos”.

Los mensajes de las autoridades ucranianas muestran el interés singular para hacerse con la imagen de las caras de los ocupantes. Hay un motivo. Al inicio de la guerra, el Gobierno de Kiev recibió la oferta de colaboración de la empresa Clearview AI con sede en los EE.UU. y especializada en reconocimiento facial. Su consejero delegado, Huan Ton-That, explicó a la CNN que ofrecieron su herramienta por carta al Ejecutivo de Kiev y la aceptó. Luego entrenaron a técnicos ucranianos para utilizar este programa (video minuto 2:00).

El software de Clearview AI usa la Inteligencia Artificial para cruzar la información de una cara concreta con una base de datos de reconocimiento facial elaborada a partir de fotos disponibles en Internet. En el contexto de esta guerra, esta empresa asegura que dispone de 2.000 millones de caras extraídas de la red social rusa VKontakte que forman parte de un banco total formado por 20.000 millones de fotografías.

Ucrania envía fotos de rusos muertos a sus familias

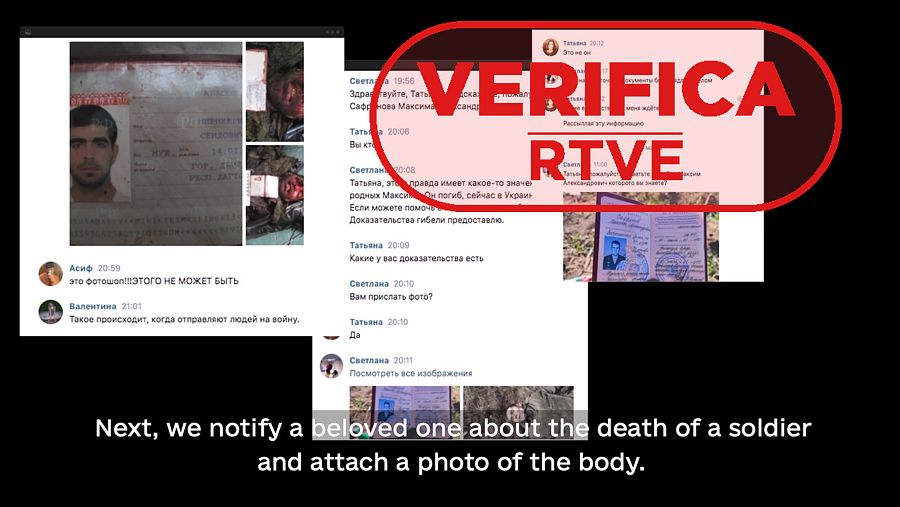

El uso que el Gobierno ucraniano está haciendo de esta información es controvertido. Tras la tragedia de Bucha, el 3 de abril, el presidente Zelensky se dirigió en ruso a los ciudadanos del país ocupante con este mensaje: “Quiero que cada madre de cada soldado ruso vea los cuerpos los muertos en Bucha”. Al día siguiente, el grupo para-oficial “IT ARMY of Ukraine”, constituido al inicio de la invasión bajo el patronazgo del ministro de Transformación Digital de Ucrania Mykhailo Fedorov y compuesto por voluntarios aficionados a la tecnología, publicó un video en Telegram donde explica cómo identifican las caras de los soldados fallecidos con una herramienta de reconocimiento facial. Luego, dice el vídeo, “notificamos a sus seres queridos la muerte del soldado y adjuntamos una foto del cadáver”. En el video se observa una muestra del mensaje que envían a sus familias en Rusia (vídeo minuto 1:37).

Captura del vídeo de 'IT Army of Ukraine' donde se ofrece una muestra del mensaje que se envía a las familias de los soldados rusos muertos con una foto del cadáver VerificaRTVE

En CNN, Huan Ton-That explicó que, hasta el 5 de abril, 582 militares rusos muertos habían sido identificados con su herramienta (Vídeo, minuto 4:20). La periodista especializada en ética y tecnología Setphanie Hare se ha posicionado en Twitter contra esta práctica: “Si fueran soldados rusos haciendo esto a madres ucranianas diríamos “¡Dios mío! Esto es de bárbaros”.

Búsqueda de soldados rusos por delitos o crímenes

En mensajes publicados en redes sociales, las autoridades vinculan las fotos recogidas con las herramientas de colaboración ciudadana con la persecución de criminales de guerra. El ministro de Transformación Digital de Ucrania, Mykhailo Fedorov, ha publicado en Twitter que 275.000 personas usan el chatbot “e-Enemigo” para facilitar información y que sus equipos trabajan “24/7 para procesar los datos''. Cada enemigo, dice, ”será encontrado y destruido”.

En otro mensaje Fedorov publica un ejemplo del funcionamiento del sistema de reconocimiento facial contra las fuerzas ocupantes. Dice: “Nuestra tecnología los encontrará a todos [los saqueadores rusos]”. Luego publica el nombre de una persona a la que acusa de robar 100 Kg de ropa en Ucrania para enviarla luego a una ciudad rusa. Con este texto difunde una foto de un jóven junto a una mujer con el mensaje “Yo robé 100 kg de ropa”. Otro mensaje muestra dos imágenes de un soldado ruso con el texto: “Este es el oficial de las fuerzas especiales rusas. Asesinó y robó a civiles en Bucha, Irpin y Hostomel”.

La posibilidad de que la tecnología de reconocimiento facial dé lugar a “falsos positivos” (la identificación de una persona distinta de la real) ha generado un profundo debate ético y tecnológico. Clearview AI se defiende diciendo que “no se ha producido ninguna detención errónea” debido al uso de su programa. Ante el uso de este software en Ucrania, el fundador de la ONG Proyecto de supervisión de la vigilancia tecnológica, Albert Fox Cahn, ha asegurado en Twitter: “Es un error mortal”. “Cuando la policía comete un error con el reconocimiento facial se arresta a un inocente. Cuando la búsqueda de los militares es errónea se mata a civiles”, avisa.

Clearview AI, una herramienta controvertida

Al margen del uso concreto que el Gobierno de Ucrania está haciendo del software de reconocimiento facial, la herramienta Clearview AI ha sido motivo de contestación internacional. Este programa recorre Internet buscando fotografías que procesa para su identificación. Según una presentación comercial filtrada a The Washington Post, el objetivo de la compañía es disponer de una base de datos con 100.000 millones de fotografías para realizar reconocimiento facial. La presentación afirma: “Casi cualquier persona del mundo será identificable”. En su web Clearview AI se publicita con el siguiente texto: “Nuestras soluciones permiten a los cuerpos de seguridad conseguir información y desestabilizar a los criminales”. En otro documento de la compañía fechado en enero de 2022 se afirma que “sirve a 3.100 entidades de seguridad en los EE.UU”.

El uso de las fotografías en el espacio público digital con fines no previstos por aquellos que las subieron ha llevado a personas e instituciones a pedir que Clearview AI cese en su actividad. La autoridad de protección de datos francesa prohibió expresamente “la reutilización de fotografías disponibles en Internet” en Francia desde febrero de 2022 por vulnerar el Reglamento Europeo en materia de Protección de Datos (RGPD). La Asociación Estadounidense por las Libertades Civiles (ACLU), junto con otras organizaciones, ha demandado a Clearview AI ante los tribunales de Illinois (EE.UU.) por vulnerar las leyes de este estado relativas al uso de datos biométricos personales. Esta demanda está pendiente de juicio.