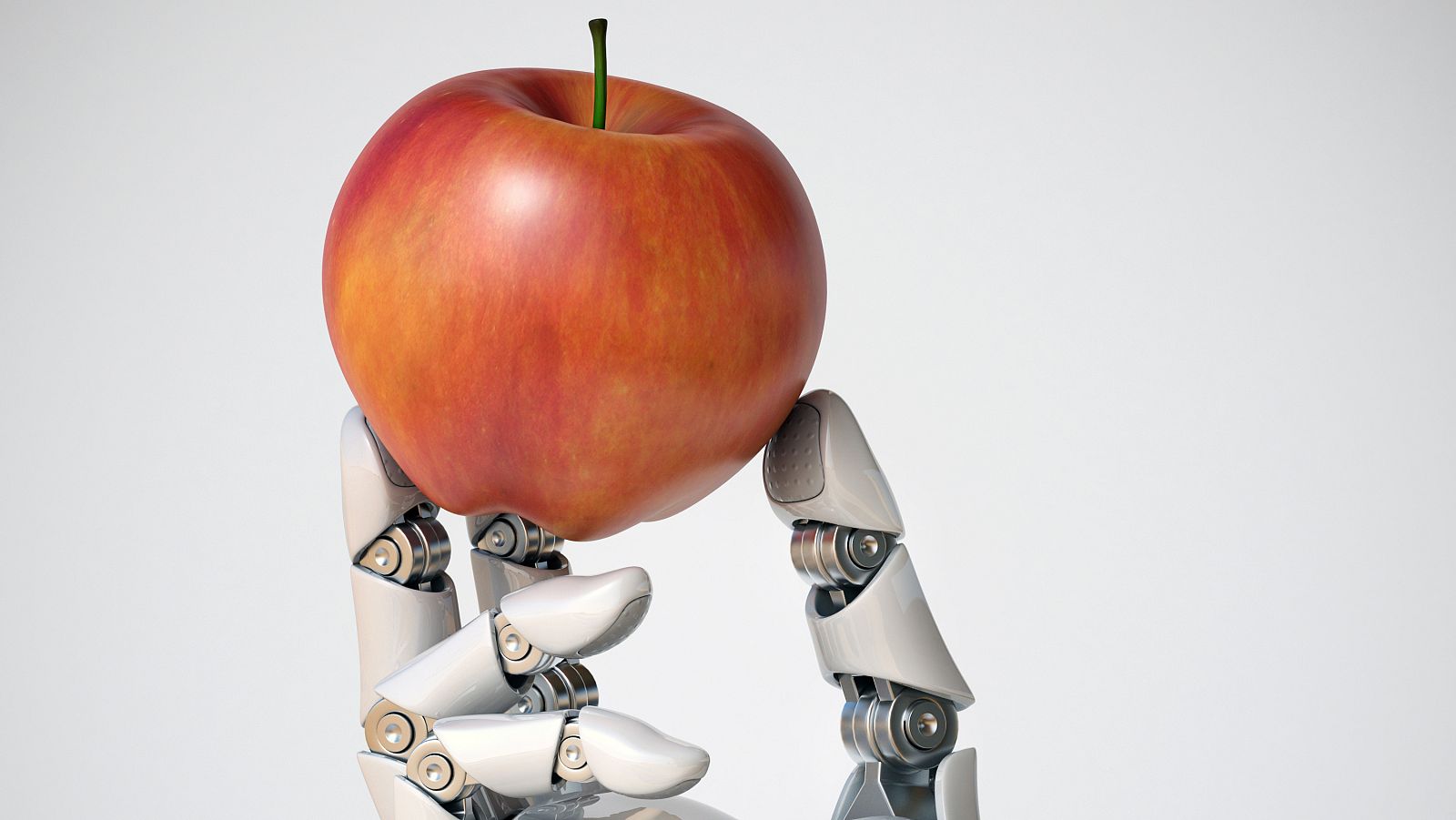

Investigadores del MIT desarrollan un sistema para que los robots puedan reconocer un objeto a través del tacto

- Podrán encontrar distintos elementos sin información visual, por ejemplo, en una habitación a oscuras

Investigadores del Instituto de Tecnología de Massachusetts (MIT), en Estados Unidos, están desarrollando un nuevo sistema que permite a los robots reconocer objetos a través del tacto para que puedan encontrar distintos elementos cuando no tengan información visual, por ejemplo, en una habitación a oscuras, y para que puedan saber qué tacto tendrá un objeto solo con verlo.

Según el comunicado emitido por el MIT, actualmente existen robots que están programados para sentir o para ver, pero este nuevo sistema de inteligencia artificial, desarrollado por investigadores de su laboratorio de inteligencia artificial y ciencias de la computación (CSAIL), permite que el robot pueda aprender a ver a través del tacto y a sentir una superficie utilizando la vista de manera similar a como lo hacen los humanos.

Para ello, han utilizado un brazo de robot KUKA con un sensor táctil especial llamado GelSight, diseñado por otro equipo del MIT. "El método del equipo permite crear señales táctiles realistas a partir de estímulos visuales, y predecir qué objeto y qué parte se toca directamente, a partir de esos estímulos táctiles", aseguran en el comunicado.

El modelo se basa en un sistema de asociación de imagen del objeto con su entorno, por lo que han recopilado en una base de datos denominada VisGel, más de tres millones de imágenes emparejadas por visual o táctil. Para ello, el equipo grabó con una cámara web cerca de 200 objetos, como herramientas o productos del hogar que habían sido tocados más de 12.000 veces, y convirtieron los clips de vídeo en imágenes estáticas que almacenaron siguiendo ese criterio.

A ciegas

"Mirando la escena, nuestro modelo puede imaginar la sensación de tocar una superficie plana o un borde afilado", asegura Yunzhu Li, estudiante de doctorado del CSAIL y autor principal del nuevo informe sobre este sistema. "Tocando a ciegas, nuestro modelo puede predecir la interacción con el entorno puramente desde las sensaciones táctiles. Los dos sentidos juntos pueden empoderar al robot y reducir los datos que podríamos necesitar para tareas que supongan la manipulación o el agarre de objetos".

Así, para que el robot pueda identificar un objeto a través del tacto, el sistema primero tuvo que localizar dónde se iba a tocar el objeto y después deducir su forma y su textura. Las imágenes de referencia ayudaron a codificar detalles sobre el mismo y su entorno.

Seguidamente introdujeron el brazo de robot, que comparó lo que estaba viendo con la imagen de referencia, e identificó la localización y el nivel de tacto. De tal forma, su funcionamiento se basa en que se le proporciona una imagen al sistema y luego el robot ve el área que el modelo ha predicho como zona de agarre.

En el caso de que el robot pueda reconocer un objeto visualmente a través del tacto, permitiendo que encuentre elementos en lugares donde no hay luz, como por ejemplo una habitación a oscuras, el modelo analizó una imagen táctil, e identificó la forma y el material. Después buscó la imagen de referencia para proceder a la interacción.

Redes adversarias generativas (GANs)

Además de la base de datos, utilizan lo que denominan redes adversarias generativas (GANs), que usan imágenes visuales o táctiles para generar imágenes en otra modalidad. Hacen que compitan un "generador" y un "discriminador", donde el primero tiene como objetivo crear imágenes realistas que engañen al segundo.

Cada vez que el 'discriminador' caze al 'generador' en su engaño, éste tiene que exponer las razones por las que ha tomado la decisión, de tal forma que el 'generador' se puede estar mejorando a sí mismo continuamente.