Esta imagen de un soldado abatido no es real, está editada con inteligencia artificial

En redes sociales circula una instantánea de un soldado abatido a punto de caer al suelo junto a mensajes que la presentan como si fuera una foto real tomada en Jan Yunis, en la Franja de Gaza. Es falso. Se trata de una imagen alterada con inteligencia artificial (IA), tal y como concluyen herramientas de detección de contenidos creados con esta tecnología y expertos consultados por VerificaRTVE.

La fotografía que circula en redes sociales muestra a un soldado abatido a punto de caer al suelo en la puerta de una vivienda. La instantánea se difunde en X junto a un mensaje en inglés compartido más de 5.000 veces desde el 25 de junio que dice: "Es una foto real en Jan Yunis y no de inteligencia artificial. Brigadas Al-Qassam".

La fotografía de un soldado cayendo al suelo está editada con herramientas de inteligencia artificial. En respuesta a una de las publicaciones que difunde la imagen, un usuario comparte este vídeo de 4 segundos de duración que muestra la escena que representa la instantánea en movimiento. La grabación es un extracto de un vídeo difundido el 24 de junio por las Brigadas Ezedín al Qasam, el brazo armado de Hamás, en Telegram. Sostienen que los hechos suceden el 18 de junio en Jan Yunis y que el militar del Ejército israelí muere por el disparo de un francotirador palestino en una operación conjunta con otra milicia palestina en Gaza. A través de una búsqueda inversa con fotogramas de esta grabación, hemos localizado esta otra foto. Los expertos consultados por VerificaRTVE sostienen que la imagen de redes se ha generado a partir de estos contenidos.

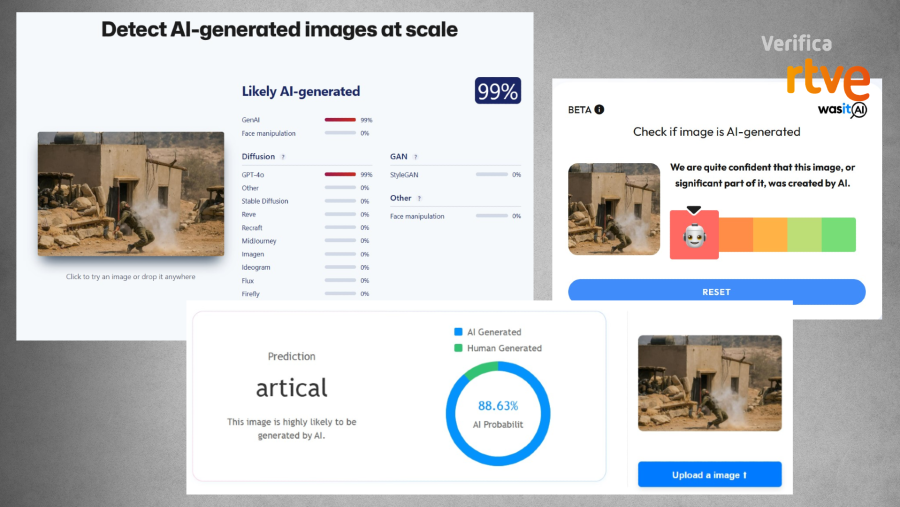

En VerificaRTVE hemos analizado la imagen con varias herramientas de detección de contenidos generados con IA y todas concluyen que se trata de una instantánea creada con esta tecnología con casi un 100% de confianza en su predicción. En concreto, hemos utilizado las herramientas del proyecto IVERES de RTVE, Sight Engine, Was It AI y AI Or Not. Puedes comprobar algunos de estos resultados en la siguiente imagen.

Resultados que ofrecen herramientas de detección de IA sobre la foto del soldado VerificaRTVE

Una imagen de IA, según los expertos

El experto en armamento y material de defensa Juanjo Fernández asegura a VerificaRTVE que "la foto está generada con inteligencia artificial" y señala detalles que ponen de manifiesto que no es una imagen real. En concreto, menciona que el militar atacado no lleva chaleco antifragmentos y su uniforme no luce parches ni elementos identificativos. También apunta al hecho de que el militar que está en un puesto de vigía aparece aparentemente impasible cuando se están registrando disparos.

Para el profesor de la Universidad Politécnica de Cataluña y consejero delegado de Ugiat Technologies, Francesc Tarrés, la imagen también "ha sido generada con IA o con el uso de mucho retoque fotográfico" Argumenta que "posiblemente, se utiliza la imagen en blanco y negro como input para producir una imagen de mayor calidad, con interpolado y mejora de color", aunque aclara que "incluso las versiones actuales de Photoshop tienen algunos filtros que permitirían realizar la mejora de imagen" A su juicio, la herramienta que podría haberse utilizado para llevar a cabo la edición es ChatGPT.

Tarrés referencia algunos aspectos que denotan que la imagen no es real, como la "inconsistencia en las sombras", donde no coinciden la "sombra cenital de los cables del tejado de la casa, que parece indicar que la posición del sol es casi de mediodía" Sin embargo, explica, "el umbral de la puerta de la casa no produce esta sombra, sino una mucho más lateral" "Ninguna de ellas", añade, "tiene consistencia con la sombra del soldado". Sobre la posición del soldado, se manifiesta en la misma línea que Juanjo Fernández, indicando que "es demasiado teatral y parece haber sido desplazado de la posición original para conseguir un efecto mucho más dramático"

En VerificaRTVE ya te hemos dado consejos para detectar imágenes generadas con inteligencia artificial que en redes sociales presentan como si fueran reales. Además, te hemos explicado cómo se ha usado esta tecnología para desinformar sobre el conflicto entre Irán e Israel.